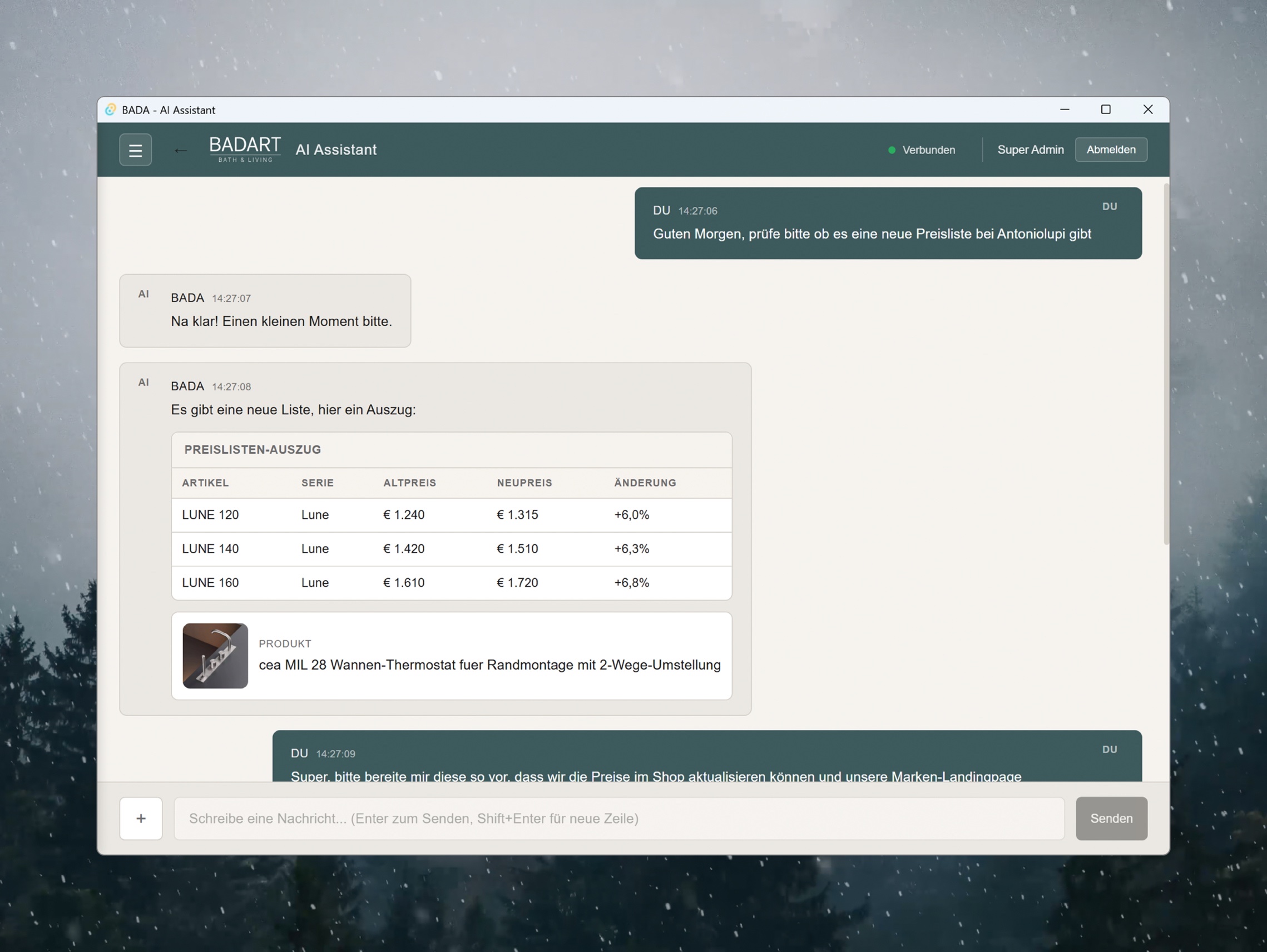

Das Problem mit "nackten" LLMs.

ChatGPT ist schlau, aber es kennt deine Firma nicht. Wenn du fragst: "Wie ist unsere Rückgaberichtlinie für Kaffeebohnen?", halluziniert es irgendwas.

Früher (Old School Chatbots) haben wir Entscheidungsbäume gebaut.

IF Keyword == "Rückgabe" THEN GOTO Node_5.

Das war starr und dumm.

Die Lösung: RAG (Retrieval Augmented Generation).

Das ist der aktuelle Gold-Standard, den wir auch für Kunden wie Ready4PPWR einsetzen. So funktioniert's unter der Haube:

- Ingest: Wir nehmen deine PDFs, Handbücher, Website-Daten.

- Embed: Wir wandeln Text in Vektoren (Zahlenreihen) um und speichern sie in einer Vektor-Datenbank (z.B. Pinecone).

- Retrieve: Der User stellt eine Frage. Wir suchen in der DB die semantisch passenden Textstellen.

- Generate: Wir füttern das LLM mit der Frage + den gefundenen Textstellen als Kontext.

Resultat: Das LLM antwortet flüssig (wie ein Mensch), aber faktisch korrekt (basierend auf deinen Daten).

Warum das Game-Changing ist.

Du kannst plötzlich dein gesamtes inaktives Wissen aktivierbar machen.

Ein Bot, der dem Techniker vor Ort aus dem 500-seitigen Handbuch die richtige Seite zitiert.

Ein Bot, der komplexe EU-Verordnungen für Händler erklärt.

Das ist kein "Support-Chat" mehr. Das ist ein Wissens-Interface.

Implementation Notes.

Es gibt Fallstricke ("Chunks" müssen die richtige Größe haben, Embeddings müssen passen). Aber die Tools (LangChain, Vercel AI SDK) werden jeden Monat besser. Es gab noch nie einen besseren Zeitpunkt, um Wissen zugänglich zu machen.